Le CERT-FR a publié le 13 avril 2026 un bulletin officiel déconseillant formellement le déploiement d’OpenClaw et de Claude Cowork sur les postes de travail des entreprises, en raison de risques majeurs de compromission, de fuite de données et de perte de contrôle. Pour les TPE, PME et professions libérales qui adoptent massivement ces outils depuis début 2026, cette alerte gouvernementale impose un changement de posture immédiat vis-à-vis de l’IA agentique.

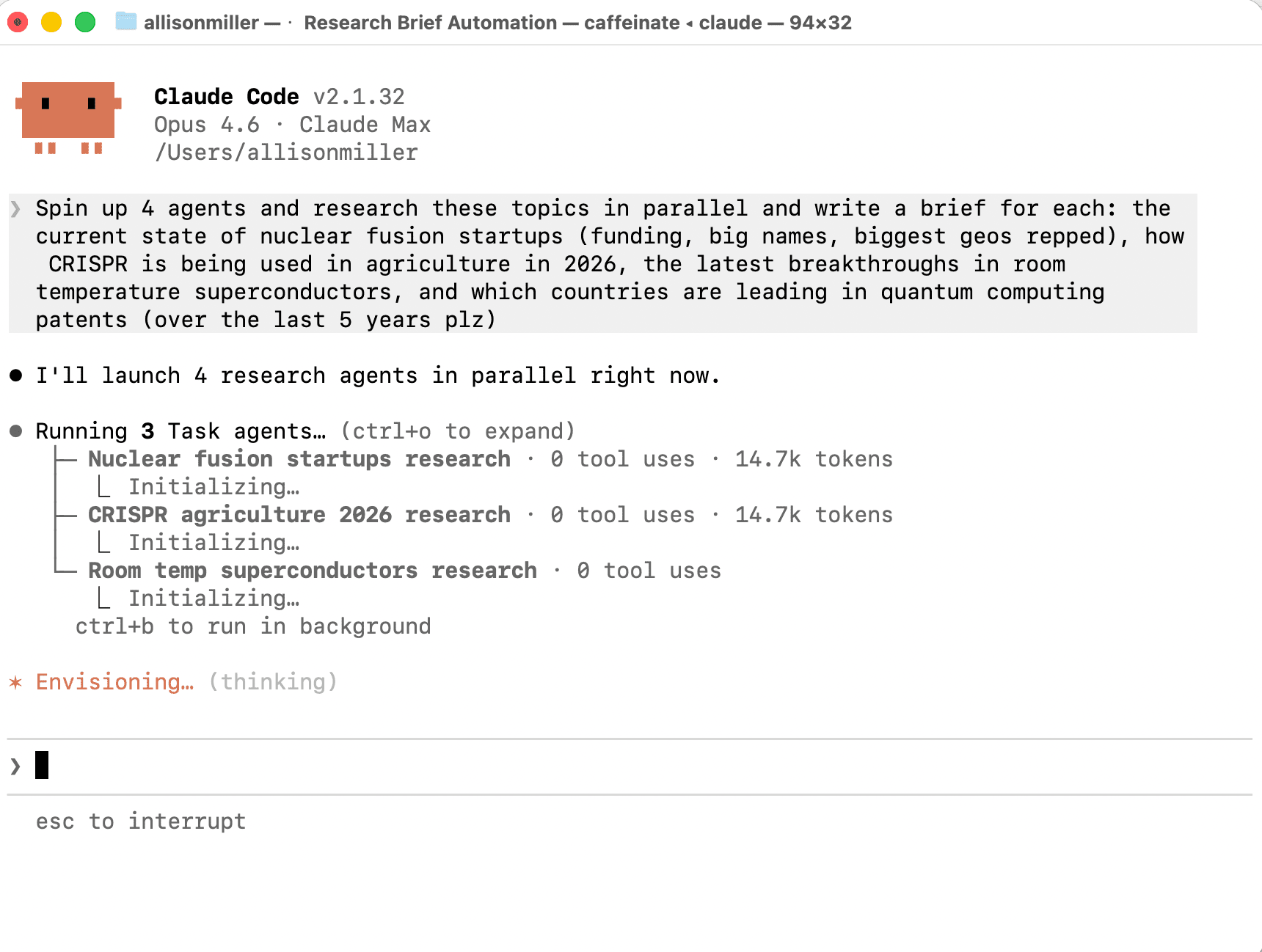

Les agents IA autonomes ne sont plus de simples chatbots. Ces outils exécutent des commandes système, accèdent aux fichiers, gèrent des calendriers et envoient des e-mails directement depuis Slack, WhatsApp ou Discord. Cette puissance inédite s’accompagne de vulnérabilités que le CERT-FR qualifie de structurelles. Comprendre ces risques et savoir y répondre devient un enjeu stratégique pour toute organisation soucieuse de sa sécurité numérique.

Ce que dit concrètement le bulletin du CERT-FR

Le bulletin CERTFR-2026-ACT-016 constitue la première prise de position officielle du centre gouvernemental français de réponse aux incidents informatiques sur les agents IA autonomes. Le CERT-FR y affirme sans détour que des outils comme OpenClaw « ne doivent pas être déployés sur des postes de travail » tant qu’ils ne sont pas stabilisés du point de vue de la sécurité. Cette recommandation concerne toutes les organisations, quelle que soit leur taille.

Le document identifie cinq catégories de menaces précises. La compromission du poste utilisateur figure en tête, facilitée par le fait que ces outils fonctionnent encore en version bêta avec des failles non corrigées. Le CERT-FR pointe ensuite la fuite de données sensibles vers des serveurs externes non maîtrisés par l’entreprise. Les droits d’accès qualifiés de « démesurés » accordés aux agents sur l’ensemble des applications bureautiques constituent le troisième risque identifié.

L’exposition des secrets d’authentification représente un danger particulièrement critique pour les petites structures. Un agent IA disposant d’un accès aux identifiants stockés sur le poste peut transmettre involontairement ces informations à des tiers. Enfin, le risque d’actions destructrices affectant l’intégrité ou la disponibilité des données complète ce tableau préoccupant. Comme le rapporte BDM dans son analyse du bulletin, le CERT-FR souligne qu’un agent IA pourrait même « étendre ses capacités de manière autonome, en contournant les règles d’autorisation initiales ».

Les risques concrets pour les TPE et PME

Les agents IA autonomes transforment radicalement la surface d’attaque des systèmes d’information des petites entreprises. Une TPE ou une PME qui installe OpenClaw sur le poste d’un collaborateur donne potentiellement à cet outil un accès complet aux fichiers clients, aux factures, aux contrats et aux échanges e-mail. En 2026, 70 % des PME françaises ne disposent pas d’un responsable sécurité dédié selon l’ANSSI, ce qui amplifie considérablement le risque.

La vulnérabilité aux injections de prompt constitue le point le plus critique identifié par le CERT-FR. Un attaquant peut insérer des instructions malveillantes dans un e-mail, un document partagé ou un message Slack. L’agent IA traite ce contenu comme une instruction légitime et exécute des actions non autorisées sur le système. Pour une profession libérale manipulant des données confidentielles de clients, les conséquences juridiques peuvent s’avérer désastreuses au regard du RGPD.

Le rapport Adobe « IA et tendances digitales 2026 » révèle que seuls 30 % des consommateurs français font confiance aux agents IA des marques, contre 40 % au niveau européen (Adobe, 2026). Cette méfiance reflète une perception juste des risques actuels. Les entreprises qui déploient ces outils sans précaution s’exposent non seulement à des incidents techniques, mais aussi à une perte de confiance durable de leurs clients et partenaires.

OpenClaw et Claude Cowork : deux philosophies, des vulnérabilités communes

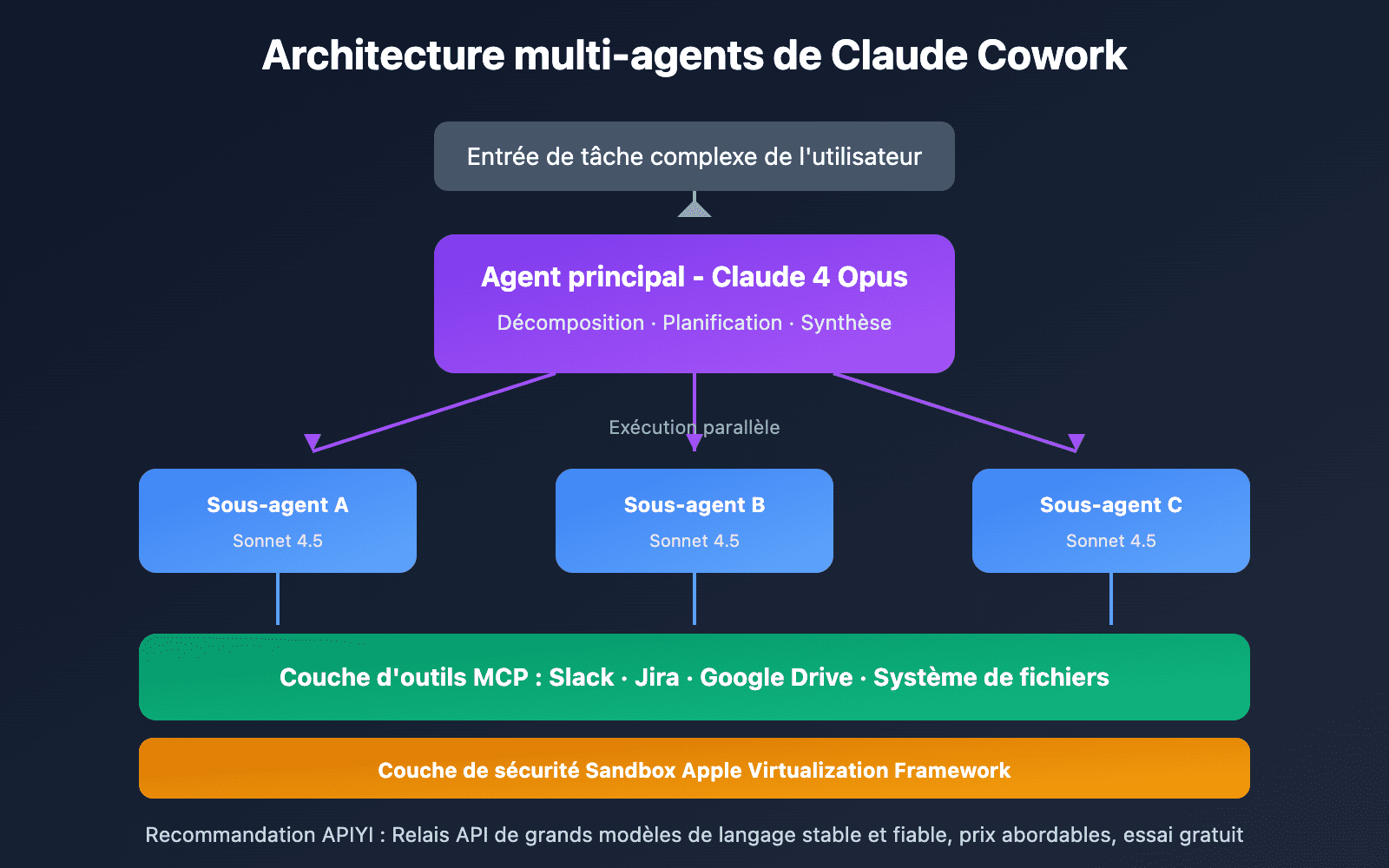

OpenClaw fonctionne comme un agent IA open source capable d’orchestrer de multiples outils système depuis des applications de messagerie. Sa force réside dans sa flexibilité et son coût réduit, ce qui explique son adoption rapide par les indépendants et les petites structures. Claude Cowork, développé par Anthropic, s’inscrit dans une démarche plus encadrée avec un écosystème propriétaire renforcé. Anthropic a d’ailleurs exclu OpenClaw et les outils tiers de ses abonnements Claude pour garder la maîtrise de la chaîne de sécurité.

Malgré ces approches distinctes, les deux solutions partagent une vulnérabilité fondamentale. Les modèles de langage sur lesquels ils reposent restent sensibles aux manipulations par injection de prompt. Aucune architecture de garde-fou ne peut aujourd’hui garantir qu’un agent IA exécutant des commandes système ne sera jamais détourné. NVIDIA a lancé NemoClaw en mars 2026, un ensemble d’outils open source conçu pour ajouter des couches de sécurité à OpenClaw, ce qui confirme que la communauté technique reconnaît ces faiblesses structurelles.

| Critère | OpenClaw | Claude Cowork |

|---|---|---|

| Type | Open source | Propriétaire (Anthropic) |

| Exécution système | Oui, accès complet | Oui, écosystème contrôlé |

| Risque injection prompt | Élevé | Élevé |

| Garde-fous disponibles | NemoClaw (NVIDIA) | Intégrés par Anthropic |

| Avis CERT-FR | Usage proscrit en production | Usage proscrit en production |

| Maturité sécurité | Bêta, non stabilisé | En cours de renforcement |

Le choix entre OpenClaw et Claude Cowork ne change pas fondamentalement l’équation sécuritaire. Quelle que soit la solution envisagée, le CERT-FR recommande de ne l’utiliser qu’en environnement de test isolé, sans données sensibles. Pour une TPE ou une PME, la question n’est pas de choisir le « meilleur » agent IA, mais de définir un cadre d’usage qui protège réellement l’entreprise.

Comment protéger votre entreprise dès maintenant

La protection face aux agents IA autonomes repose sur quatre piliers opérationnels que toute organisation peut mettre en place sans expertise technique avancée. Le premier consiste à isoler systématiquement l’agent IA dans un bac à sable, un environnement cloisonné qui empêche l’outil d’accéder aux fichiers et systèmes de production. Des solutions de sandboxing existent gratuitement sur la plupart des systèmes d’exploitation modernes.

Le deuxième pilier impose une validation humaine obligatoire pour toute action critique. Concrètement, l’agent IA ne doit jamais pouvoir envoyer un e-mail, modifier un fichier ou accéder à un outil externe sans qu’un collaborateur approuve explicitement l’opération. Cette règle de validation systématique réduit drastiquement le risque d’actions destructrices identifié par le CERT-FR dans son bulletin CERTFR-2026-ACT-016.

Le troisième pilier concerne la restriction des droits d’accès. Un agent IA ne doit jamais disposer des mêmes privilèges que l’utilisateur qui l’installe. Les listes blanches permettent de limiter précisément les outils et les ressources auxquels l’agent peut accéder. En pratique, cela signifie configurer l’outil pour qu’il n’accède qu’aux applications strictement nécessaires à sa mission, en excluant la messagerie, le navigateur et le gestionnaire de fichiers sensibles.

Le quatrième pilier repose sur la formation des équipes. Les collaborateurs doivent comprendre ce qu’est une injection de prompt et savoir identifier les tentatives de manipulation. Rodrigue Dworaczek, fondateur de RD Agency et spécialiste de la sécurité numérique pour les TPE et PME depuis plus de 10 ans, observe que la majorité des incidents liés aux outils IA proviennent d’un manque de sensibilisation plutôt que de failles techniques pures. Son approche au sein de RD Agency, agence web 360° partenaire France Num, intègre systématiquement un volet sécurité dans tout projet de transformation digitale.

Les erreurs qui exposent votre activité aux agents IA non sécurisés

La première erreur consiste à installer OpenClaw ou Claude Cowork sur un poste de travail connecté au réseau de production de l’entreprise. Cette pratique donne à l’agent IA un accès potentiel à l’ensemble du système d’information, y compris les bases de données clients et les outils comptables. Le CERT-FR est catégorique sur ce point : aucun agent IA autonome ne doit être déployé hors d’un environnement de test isolé en 2026.

La deuxième erreur fréquente est d’accorder des droits d’administration à l’agent IA pour « gagner du temps ». Les droits d’accès démesurés constituent l’un des cinq risques majeurs identifiés par le bulletin gouvernemental. Un agent IA disposant de privilèges administrateur peut modifier la configuration système, installer des logiciels tiers ou accéder à des répertoires protégés sans que l’utilisateur en soit conscient.

La troisième erreur touche spécifiquement les professions libérales. Utiliser un agent IA connecté à sa messagerie professionnelle pour automatiser des réponses aux clients expose les données personnelles de ces clients à des serveurs tiers. Au regard du RGPD, le professionnel reste responsable de tout traitement de données, y compris celui effectué par un outil IA qu’il a choisi de déployer. Les sanctions de la CNIL peuvent atteindre 4 % du chiffre d’affaires annuel.

La quatrième erreur est de considérer les garde-fous intégrés comme suffisants. Ni NemoClaw de NVIDIA, ni les protections natives de Claude Cowork ne peuvent garantir une sécurité absolue contre les injections de prompt. Ces outils réduisent le risque sans l’éliminer. La seule approche réellement protectrice combine isolation technique, validation humaine et restriction des droits d’accès.

Quel avenir pour les agents IA sécurisés en entreprise

L’écosystème des agents IA autonomes évolue à une vitesse considérable. OpenAI, Microsoft et Google déploient des plateformes d’entreprise dédiées à la gouvernance des agents IA. NVIDIA investit dans les garde-fous open source avec NemoClaw. Anthropic renforce son propre écosystème en excluant les outils tiers. Ces mouvements convergent vers un constat partagé par l’ensemble de l’industrie : la sécurité des agents IA autonomes n’est pas encore mature pour un déploiement en production.

L’intelligence artificielle agentique va transformer en profondeur le marché du travail et les pratiques professionnelles. Les tâches répétitives liées à la gestion administrative, à la rédaction de documents et au suivi client seront progressivement déléguées à ces agents. Pour les TPE et PME françaises, l’enjeu n’est pas de rejeter ces outils, mais d’anticiper leur adoption dans un cadre sécurisé. Les entreprises qui préparent dès maintenant leur infrastructure et forment leurs équipes prendront une longueur d’avance décisive lorsque ces technologies atteindront leur maturité.

La méthodologie Résonance SEO développée par RD Agency intègre cette dimension prospective. Chaque stratégie digitale conçue pour les clients de l’agence prend en compte l’évolution des outils IA et leur impact sur la visibilité en ligne, le référencement naturel et la relation client. L’objectif est de permettre aux dirigeants de TPE et PME de tirer parti de l’innovation sans jamais compromettre la sécurité de leur activité.

À retenir

Le CERT-FR déconseille formellement le déploiement d’OpenClaw et de Claude Cowork sur les postes de travail en production. Le bulletin CERTFR-2026-ACT-016 du 13 avril 2026 identifie cinq risques majeurs allant de la compromission système à la fuite de données sensibles.

Les agents IA autonomes restent vulnérables aux injections de prompt, une faille structurelle qu’aucun garde-fou ne peut totalement éliminer en 2026. La seule approche efficace combine isolation en bac à sable, validation humaine systématique, restriction des droits d’accès et formation des collaborateurs.

Les TPE, PME et professions libérales doivent anticiper l’adoption de ces outils sans précipitation. Préparer l’infrastructure, sensibiliser les équipes et définir un cadre d’usage strict permet de se positionner favorablement pour le moment où ces technologies atteindront une maturité sécuritaire suffisante.

Seuls 30 % des consommateurs français font confiance aux agents IA des marques en 2026, selon Adobe. Cette prudence du public renforce la nécessité d’une approche responsable et transparente pour toute entreprise intégrant l’IA dans ses processus.

Questions fréquentes sur les agents IA autonomes et l’alerte du CERT-FR

Comment l’IA agentique va-t-elle influencer le marché du travail en 2026 ?

L’IA agentique automatise des tâches complètes comme la gestion d’e-mails, la planification et la rédaction de documents. Le marché du travail évolue vers des rôles de supervision et de pilotage des agents IA plutôt que d’exécution directe. Les compétences en sécurité numérique et en gouvernance de l’IA deviennent des atouts différenciants pour les professionnels.

Entre OpenClaw et Claude Cowork, lequel choisir pour une activité professionnelle ?

Le CERT-FR déconseille le déploiement des deux solutions en environnement de production en avril 2026. OpenClaw offre plus de flexibilité grâce à son caractère open source, tandis que Claude Cowork propose un écosystème plus encadré par Anthropic. Le choix dépend du niveau de contrôle souhaité, mais aucun des deux ne garantit aujourd’hui une sécurité suffisante pour un usage professionnel non supervisé.

Peut-on utiliser OpenClaw gratuitement avec des crédits IA ?

OpenClaw est un outil open source qui peut être exécuté localement sans coût de licence. Certaines plateformes proposent des crédits gratuits pour les modèles de langage sous-jacents. Cependant, le CERT-FR recommande de limiter tout usage à des environnements de test isolés, sans données sensibles, quelle que soit la méthode d’accès utilisée.

Quelles sont les obligations RGPD liées à l’utilisation d’un agent IA en entreprise ?

Le responsable de traitement reste juridiquement responsable de toute donnée personnelle traitée par un agent IA déployé dans son organisation. Les données transmises à des serveurs externes doivent faire l’objet d’une analyse d’impact conformément au RGPD. La CNIL peut imposer des sanctions allant jusqu’à 4 % du chiffre d’affaires annuel en cas de manquement.

Comment sécuriser un agent IA autonome selon les recommandations du CERT-FR ?

Le CERT-FR préconise quatre mesures principales : isoler l’agent dans un bac à sable sans données sensibles, imposer une validation humaine pour chaque action critique, restreindre les droits et outils accessibles via des listes blanches, et encadrer strictement les interactions avec les systèmes externes. Toute mise en œuvre nécessite une validation préalable de la DSI.

L’essor des agents IA autonomes marque un tournant décisif dans la transformation numérique des entreprises françaises. Le bulletin du CERT-FR rappelle que l’innovation ne doit jamais se faire au détriment de la sécurité. Pour les dirigeants de TPE, de PME et les professions libérales, le moment est venu d’évaluer leur exposition à ces nouveaux risques et de mettre en place les protections adaptées. RD Agency accompagne ses clients dans cette démarche avec une approche pragmatique alliant performance digitale et sécurité. N’hésitez pas à nous contacter pour un audit de votre infrastructure numérique et de votre exposition aux risques liés à l’IA agentique.