Les limites de crawl de Googlebot ne sont pas figées : elles varient selon le type de contenu, le crawler utilisé et même la requête traitée. Google vient de lever le voile sur le fonctionnement interne de son infrastructure d’exploration, et les implications pour votre stratégie SEO sont considérables. Voici ce que tout professionnel du web doit savoir en 2026.

Si vous gérez un site vitrine, un e-commerce ou un blog professionnel, ces informations changent la manière dont vous devez penser l’architecture et le poids de vos pages. Les équipes de Google ont confirmé que leur système de crawl fonctionne comme un véritable service modulable, pas comme un bloc rigide appliquant les mêmes règles à tout le web.

Ce que Google a révélé sur les limites de crawl

Gary Illyes et Martin Splitt, deux ingénieurs de l’équipe Google Search, ont partagé des détails inédits sur le fonctionnement de Googlebot lors d’un épisode du podcast Search Off The Record. La révélation principale concerne la limite par défaut de 15 mégaoctets, qui s’applique au niveau de l’infrastructure globale de Google.

Concrètement, lorsque Googlebot commence à télécharger une page, un compteur interne surveille le volume de données reçues. Une fois la limite atteinte, le robot cesse de recevoir les octets restants. Mais cette limite de 15 Mo n’est qu’un réglage par défaut. Chaque équipe interne de Google peut la modifier selon ses besoins spécifiques.

Le fait marquant : Google Search, le moteur de recherche que nous utilisons tous, a volontairement réduit cette limite à 2 mégaoctets. Cela signifie que tout contenu HTML dépassant 2 Mo risque d’être tronqué par Googlebot. Pour une page web classique, 2 Mo de HTML brut représentent environ 500 000 mots, ce qui laisse une marge confortable. Mais pour les pages générées dynamiquement avec du JavaScript volumineux ou des données inline, la question se pose.

Des limites variables selon le type de contenu

L’une des informations les plus intéressantes concerne la flexibilité du système. Les limites de crawl de Googlebot ne sont pas uniformes : elles s’adaptent au format du contenu exploré. Les fichiers PDF, par exemple, bénéficient d’une limite relevée à environ 64 Mo. Cette différence s’explique simplement : un PDF technique ou réglementaire peut facilement peser plusieurs dizaines de mégaoctets sans que cela soit anormal.

Gary Illyes a pris l’exemple parlant de la spécification HTML du W3C. Exportée en PDF, elle pèse environ 96 Mo. Tenter d’indexer un tel fichier en une seule passe surchargerait l’infrastructure de Google. C’est pourquoi le moteur préfère explorer les pages individuelles de la documentation plutôt que le document monolithique.

Martin Splitt a également précisé que les images bénéficient probablement de seuils supérieurs à 2 Mo, puisqu’une photo de qualité dépasse facilement cette taille. Le tableau ci-dessous résume les limites connues selon le type de contenu.

| Type de contenu | Limite de crawl | Remarque |

|---|---|---|

| HTML (Google Search) | 2 Mo | Limite réduite par rapport au défaut |

| Défaut infrastructure | 15 Mo | Applicable si non surchargé |

| ~64 Mo | Relevée pour les documents longs | |

| Images | Supérieure à 2 Mo | Adaptée aux formats visuels |

| Indexation rapide | ~1 Mo (hypothèse) | Pour le pipeline d’indexation urgente |

Cette flexibilité confirme une réalité que les professionnels du référencement naturel soupçonnaient depuis longtemps : Googlebot n’est pas un outil monolithique, mais un écosystème de services configurables.

Pourquoi c’est important pour votre site

Pour un dirigeant de TPE ou de PME, ces informations techniques ont des conséquences très concrètes. Si vos pages web sont trop lourdes en HTML, Googlebot risque de ne pas les explorer intégralement. Le contenu situé au-delà de la limite de 2 Mo ne sera tout simplement pas indexé. Vos mots-clés stratégiques, vos appels à l’action ou vos informations de contact placés en bas de page pourraient être invisibles pour Google.

Ce risque est particulièrement réel pour trois types de sites. Les catalogues produits avec des pages de catégorie très longues, les sites one-page qui concentrent tout le contenu sur une seule URL, et les pages générées par des constructeurs visuels (page builders) qui injectent énormément de code HTML superflu. Un site WordPress utilisant certains builders peut facilement générer 200 à 400 Ko de HTML pour une page qui n’en nécessiterait que 30 Ko.

Comme le souligne Search Engine Journal, Martin Splitt a insisté sur le fait que l’infrastructure de crawl de Google fonctionne comme un « logiciel en tant que service » (SaaS). Chaque requête de crawl peut avoir sa propre configuration. Cette approche modulaire signifie que Google optimise en permanence la manière dont il explore le web, et que les limites documentées ne représentent qu’une partie de la réalité.

Chez RD Agency, Rodrigue Dworaczek accompagne depuis plus de 10 ans les TPE et PME dans l’optimisation de leur visibilité en ligne. Fort de cette expérience terrain, il constate régulièrement que les problèmes de crawl sont sous-estimés par les entreprises. Un audit technique révèle souvent des pages critiques partiellement explorées, ce qui freine directement le positionnement dans les résultats de recherche.

Comment adapter votre site à ces contraintes

La bonne nouvelle, c’est que respecter les limites de crawl de Googlebot ne demande pas de compétences techniques avancées. Quelques bonnes pratiques suffisent à garantir que vos pages sont explorées intégralement.

Commencez par vérifier le poids HTML de vos pages principales. Vous pouvez utiliser l’outil « Afficher la source » de votre navigateur et observer la taille du fichier. Si une page dépasse 500 Ko de HTML brut, c’est un signal d’alerte. Les outils comme Screaming Frog ou la Google Search Console permettent d’identifier rapidement les pages les plus volumineuses de votre site.

Ensuite, privilégiez la pagination plutôt que les pages infinies. Si votre catalogue produit contient 200 articles, répartissez-les sur plusieurs pages au lieu de tout charger sur une seule URL. Cette approche facilite le travail de Googlebot et améliore aussi l’expérience utilisateur.

Pour les sites WordPress, le choix du thème et du constructeur de pages a un impact direct sur le poids HTML. Un thème léger comme GeneratePress ou Astarter produit un code bien plus propre qu’un builder lourd. Si vous envisagez une refonte, pensez à consulter un spécialiste de la création de site internet qui intègre ces contraintes techniques dès la conception.

Concernant les fichiers PDF, veillez à ce que vos documents ne dépassent pas 64 Mo si vous souhaitez qu’ils soient indexés. Pour les brochures commerciales ou les catalogues, découpez-les en plusieurs fichiers thématiques plutôt qu’un seul document volumineux.

Enfin, placez toujours vos informations les plus importantes en haut de page. Googlebot lit les pages de haut en bas. Vos mots-clés prioritaires, votre proposition de valeur et vos coordonnées doivent apparaître dans les premiers kilooctets du code HTML.

Les erreurs qui freinent l’exploration de vos pages

La première erreur fréquente consiste à ignorer le poids réel de ses pages. Beaucoup de dirigeants se focalisent sur la vitesse de chargement (mesurée par PageSpeed Insights) sans vérifier le volume de HTML transmis. Or ces deux métriques sont distinctes. Une page peut se charger rapidement grâce au cache navigateur tout en envoyant un volume de données excessif à Googlebot.

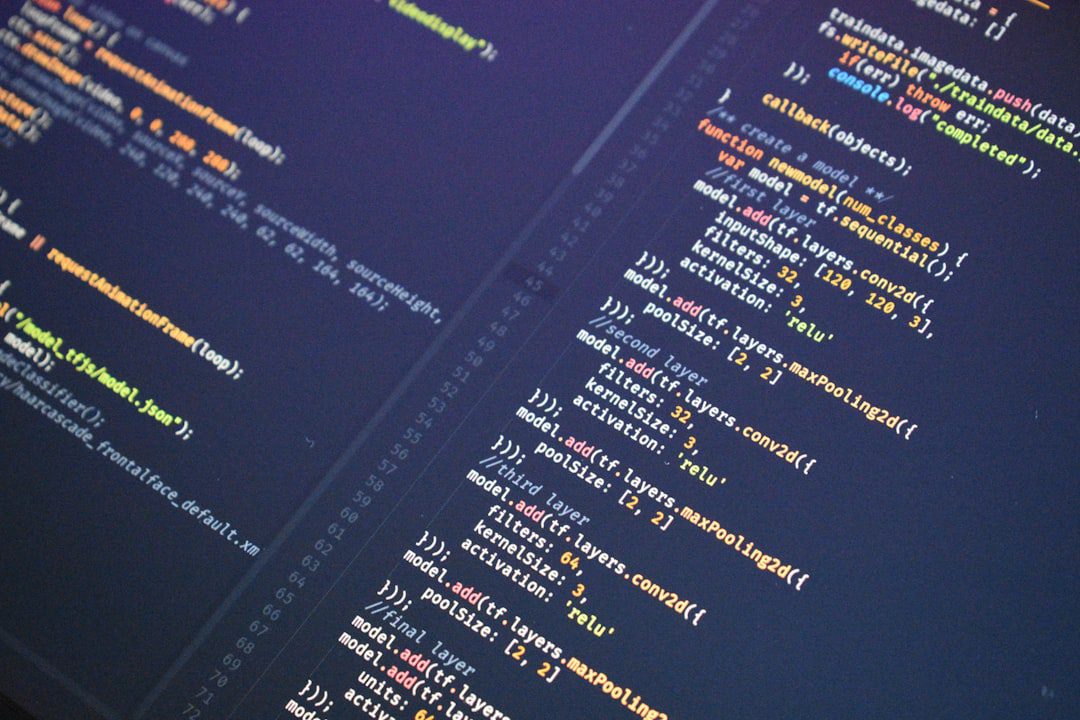

La deuxième erreur concerne les pages générées dynamiquement par JavaScript. Si votre contenu principal dépend d’appels API côté client, Googlebot doit d’abord exécuter le JavaScript avant d’accéder au contenu. Ce processus consomme des ressources supplémentaires et peut conduire à une indexation partielle. Le rendu côté serveur (SSR) reste la solution la plus fiable pour garantir une exploration complète.

Troisième piège : accumuler du code inutile au fil du temps. Chaque plugin WordPress, chaque widget, chaque script analytique ajoute du poids à vos pages. Un site lancé il y a 3 ans avec 5 plugins peut aujourd’hui en compter 25, avec un code HTML qui a triplé de volume. Un audit régulier du marketing digital de votre site permet d’identifier et de supprimer ces surcharges.

Dernière erreur courante : négliger le fichier robots.txt et le sitemap XML. Ces deux fichiers guident Googlebot dans l’exploration de votre site. Un robots.txt mal configuré peut bloquer l’accès à des pages importantes, tandis qu’un sitemap obsolète oriente Googlebot vers des pages inexistantes, gaspillant ainsi votre budget de crawl.

À retenir

La limite de crawl par défaut de Googlebot est de 15 Mo au niveau de l’infrastructure, mais Google Search la réduit à 2 Mo pour les pages HTML. Tout contenu dépassant ce seuil risque d’être tronqué et partiellement indexé.

Ces limites ne sont pas fixes. Elles varient selon le type de contenu (HTML, PDF, images) et peuvent même changer d’une requête à l’autre. L’infrastructure de Google fonctionne comme un service modulable, pas comme un système rigide.

Pour les TPE et PME, l’action prioritaire est de vérifier le poids HTML de leurs pages principales et de s’assurer que le contenu stratégique apparaît dans les premiers kilooctets du code source.

Le choix d’un thème léger, la pagination des catalogues et le nettoyage régulier des plugins sont les trois leviers les plus efficaces pour optimiser l’exploration de votre site par Googlebot.

Questions fréquentes

Quelle est la limite de crawl de Googlebot pour les pages web ?

Google Search applique une limite de 2 Mo pour le contenu HTML des pages web. Cette limite est inférieure au seuil par défaut de 15 Mo fixé au niveau de l’infrastructure globale de Google. Au-delà de 2 Mo de HTML, le contenu de votre page risque de ne pas être indexé intégralement.

Pourquoi les limites de crawl sont-elles importantes pour le SEO ?

Si Googlebot ne peut pas explorer l’intégralité de votre page, les mots-clés, les liens et le contenu situés au-delà de la limite ne seront pas pris en compte pour le classement. Cela peut directement affecter votre positionnement dans les résultats de recherche, surtout sur les pages longues ou les catalogues produits.

Comment vérifier si mes pages dépassent les limites de crawl ?

Utilisez des outils comme Screaming Frog, Sitebulb ou la Google Search Console (rapport de couverture) pour identifier les pages dont le HTML dépasse 500 Ko. Vous pouvez aussi afficher le code source d’une page dans votre navigateur et vérifier sa taille. Les pages générées par des constructeurs visuels WordPress sont souvent les plus volumineuses.

Les limites de crawl sont-elles les mêmes pour tous les types de fichiers ?

Non. Google applique des limites différentes selon le format. Les pages HTML sont limitées à 2 Mo pour Google Search, les PDF à environ 64 Mo, et les images bénéficient de seuils adaptés à leur nature. Chaque crawler interne de Google peut avoir sa propre configuration, ce qui rend le système très flexible.

Comment optimiser son site pour respecter les limites de Googlebot ?

Privilégiez un code HTML léger en choisissant un thème optimisé, limitez le nombre de plugins, paginez vos contenus longs et placez les informations essentielles en haut de page. Un audit technique régulier permet de détecter les pages trop volumineuses avant qu’elles n’affectent votre référencement.

Prochaines étapes pour votre visibilité en ligne

Les révélations de Google sur le fonctionnement interne de Googlebot confirment une tendance de fond : le moteur de recherche devient de plus en plus sélectif dans sa manière d’explorer le web. Pour les entreprises, cela signifie qu’un site techniquement propre n’est plus un bonus, c’est une condition de base pour être correctement référencé.

Les prochaines évolutions iront probablement vers des limites encore plus dynamiques, ajustées en temps réel selon la qualité perçue du site et la pertinence du contenu. Les sites qui anticipent ces contraintes techniques gagnent un avantage concurrentiel durable sur leur marché local.

Si vous n’avez jamais fait auditer la santé technique de votre site, c’est le moment idéal pour commencer. RD Agency, agence web partenaire France Num basée à Paris, propose des audits SEO complets incluant l’analyse du crawl, du poids des pages et de l’indexation. N’hésitez pas à nous contacter pour faire le point sur la visibilité de votre site.