Publier 500 articles par mois générés par intelligence artificielle ne vous rendra pas visible sur Google. C’est même l’inverse qui se produit : depuis 2024, Google pénalise activement les sites qui misent sur le volume au détriment de la qualité, avec des baisses de trafic allant jusqu’à 100 % pour les domaines ciblés par des actions manuelles.

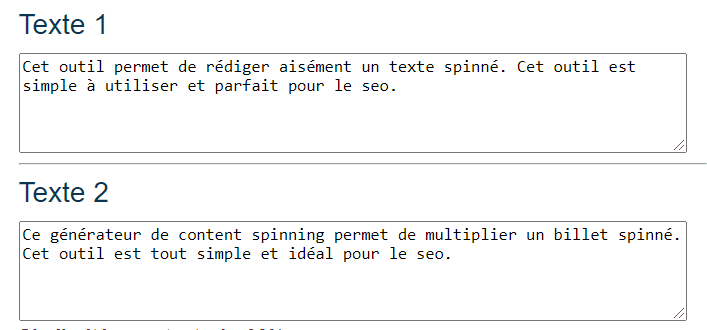

Chaque année, une nouvelle technologie promet aux entreprises de “scaler” leur production de contenu. Spinning d’articles en 2010, SEO programmatique en 2018, contenu IA en masse depuis 2023. Le résultat est toujours le même : un effondrement du trafic quand les algorithmes rattrapent la stratégie. Pourtant, des dirigeants de TPE et PME continuent d’investir dans ces approches, séduits par la promesse d’un volume qui compenserait le manque de substance.

Cet article décrypte, avec un regard de praticien, pourquoi cette logique de production industrielle échoue systématiquement, et surtout comment construire une stratégie de contenu qui résiste aux mises à jour de Google.

Du content spinning à l’IA générative : 15 ans d’échecs répétés

L’industrie du SEO fonctionne par cycles. Tous les cinq à sept ans, un nouvel outil apparaît et promet de résoudre le problème de la création de contenu à grande échelle. Et à chaque fois, le scénario se répète avec une précision presque comique.

Entre 2008 et 2011, le content spinning permettait de transformer un article en dizaines de variantes par substitution de synonymes. Le résultat était illisible, mais indexé. Puis la mise à jour Google Panda, en février 2011, a touché près de 12 % des requêtes de recherche. Demand Media, symbole de cette époque, a affiché une perte de 6,4 millions de dollars l’année suivante.

De 2015 à 2022, le SEO programmatique a pris le relais. Le principe : créer des milliers de pages à partir de templates remplis automatiquement avec des données structurées. “Meilleur plombier à Lyon”, “Meilleur avocat à Marseille”, générés par milliers. Certaines de ces pages apportaient une vraie utilité quand les données sous-jacentes étaient solides. La majorité n’étaient que des pages-portes déguisées.

Depuis 2023, l’IA générative a ouvert un nouveau chapitre. Comme le souligne Search Engine Journal dans une analyse détaillée, la promesse est identique (“500 articles par mois !”), seul l’outil a changé. Le problème fondamental reste le même : un contenu unique n’est pas forcément un contenu utile.

| Période | Technique de scaling | Correction Google | Impact observé |

|---|---|---|---|

| 2008-2011 | Content spinning | Google Panda (fév. 2011) | 12 % des requêtes impactées |

| 2015-2022 | SEO programmatique | Mises à jour Core (2022) | Désindexation des pages-portes |

| 2023-2026 | Contenu IA en masse | Actions manuelles (juin 2025) | Disparition complète des SERP |

Ce tableau n’est pas une coïncidence. C’est un schéma. Et c’est exactement ce schéma que Rodrigue Dworaczek, fondateur de RD Agency et spécialiste du référencement naturel depuis plus de 10 ans, observe chez les entreprises qui viennent demander un audit après avoir vu leur trafic s’effondrer.

Pourquoi le volume sans substance ne fonctionne jamais

Le malentendu fondamental est celui-ci : Google n’évalue pas un contenu dans l’absolu. Il le compare à tout ce qui existe déjà dans son index sur le même sujet. Publier 200 articles sur les taux d’intérêt immobiliers ne fait pas de vous une référence. Cela fait de vous la 200e source qui dit la même chose avec des mots légèrement différents.

Il existe un seuil qualitatif incompressible : un niveau minimum de valeur originale (expertise vécue, données propriétaires, angle inédit) en dessous duquel aucun volume ne compense. Vous pouvez publier un million de pages en dessous de ce seuil, vous ne positionnerez rien d’utile.

Le phénomène s’aggrave avec les systèmes de recherche alimentés par l’IA. Une étude de 2025 sur l’évaluation des systèmes de récupération d’information pour les LLM a mis en lumière un effet pervers : les contenus de faible utilité ne restent pas simplement ignorés dans l’index. Ils perturbent activement les modèles de récupération, dégradant la qualité des réponses générées. Vos 500 articles fins ne sont pas invisibles, ils sont du bruit. Et si votre site contient aussi des pages réellement utiles, ce bruit les noie.

C’est un point que nous observons régulièrement chez RD Agency dans nos missions d’audit SEO : des sites avec 3 000 pages indexées dont 200 génèrent 95 % du trafic. Les 2 800 autres ne sont pas neutres, elles diluent les signaux de qualité du domaine entier.

Ce que Google fait concrètement aux sites qui produisent en masse

Les politiques anti-spam de Google définissent explicitement l’abus de contenu à grande échelle comme la production de pages “dans le but principal d’obtenir des classements dans les résultats de recherche et non d’aider les utilisateurs”. L’utilisation d’outils d’IA générative pour créer de nombreuses pages sans valeur ajoutée est citée nommément.

En juin 2025, Google a commencé à émettre des actions manuelles spécifiquement ciblées sur l’abus de contenu à grande échelle. Des sites au Royaume-Uni, aux États-Unis et dans l’Union européenne ont reçu des notifications Search Console citant des “techniques de spam agressives”. Les pages n’ont pas glissé dans les classements, elles ont disparu.

La mise à jour spam d’août 2025 a renforcé cette application. Les mises à jour principales suivantes ont continué à resserrer l’étau. À chaque fois, le même profil est touché : volume élevé, substance faible, absence de supervision éditoriale.

L’argument “mais nos contenus se positionnent bien” est particulièrement dangereux. Chez les clients que nous accompagnons dans leur stratégie digitale, nous rappelons systématiquement que Google agrège les signaux de qualité au niveau du site, pas seulement de la page. Des pages individuelles peuvent performer pendant que le signal global se dégrade. Quand la correction arrive (algorithmique ou manuelle), elle ne cible pas les pages une par une. Elle frappe l’ensemble.

Les 3 erreurs fatales des TPE et PME face au scaling

La première erreur est de confondre productivité et production. Utiliser l’intelligence artificielle pour accélérer la rédaction d’un article expert est intelligent. L’utiliser pour générer 50 articles génériques par semaine est destructeur. La nuance tient en un mot : supervision. Un contenu assisté par IA et relu par un expert du métier peut être excellent. Un contenu généré et publié sans intervention humaine est un risque réputationnel et SEO.

La deuxième erreur est de négliger le coût réel du contenu de masse. Les partisans du scaling oublient systématiquement les étapes de vérification. Chaque article généré par IA doit être vérifié factuellement (les LLM hallucinent), contrôlé en originalité (s’il ressemble à tout ce qui existe déjà, il n’apporte rien) et soumis à une relecture éditoriale. Si vous faites tout cela sérieusement, le coût ne baisse pas, il se déplace. Et si vous ne le faites pas, vous publiez du contenu non vérifié, potentiellement inexact, sous votre nom de marque.

La troisième erreur est de croire que le contenu est un problème industriel. La fabrication industrielle produit des sorties identiques à grande échelle. C’est précisément l’inverse de ce qui donne de la valeur à un contenu : sa spécificité, son ancrage dans l’expérience, sa capacité à dire quelque chose que le reste de l’index ne dit pas. Vous ne pouvez pas automatiser la spécificité. Vous ne pouvez pas modéliser l’expérience. Vous ne pouvez pas générer une pensée originale en lançant un prompt dans un LLM.

Les données ci-dessus reflètent les ordres de grandeur que nous observons chez RD Agency auprès de nos clients TPE et PME. Le contenu expert assisté par IA coûte plus cher à l’unité, mais génère un retour sur investissement incomparablement supérieur parce qu’il franchit le seuil qualitatif que Google exige.

Comment construire une stratégie de contenu qui tient dans le temps

La question à se poser avant de publier quoi que ce soit est simple : qu’est-ce que cette page apporte que le lecteur ne peut pas déjà trouver dans les résultats existants ? Si la réponse est “rien, mais on aura plus de pages indexées”, ce n’est pas une stratégie de contenu. C’est une dette technique en construction.

Chez RD Agency, notre méthodologie Résonance SEO repose sur un principe éprouvé : moins de pages, mais des pages qui comptent. Pour une TPE ou une PME, 10 à 15 articles de fond par trimestre, chacun adossé à une expertise métier réelle, produisent des résultats durables que 500 pages génériques n’atteindront jamais.

Concrètement, cela passe par quatre étapes. D’abord, identifier les sujets où votre expertise terrain apporte une valeur que l’IA ne peut pas fabriquer : retours d’expérience, études de cas, données internes, perspectives sectorielles. Ensuite, structurer chaque contenu pour qu’il réponde à une intention de recherche précise, pas à dix intentions diluées. Puis, utiliser l’IA comme outil d’assistance (recherche, structuration, reformulation) et non comme auteur. Enfin, mesurer la performance réelle (trafic qualifié, conversions, positionnement sur les requêtes cibles) plutôt que le volume de pages indexées.

Cette approche exige plus de réflexion en amont. Elle produit moins de contenu en volume. Mais elle construit un actif numérique qui résiste aux mises à jour algorithmiques parce qu’il repose sur ce que Google cherche depuis toujours : du contenu qui mérite d’exister. Rodrigue Dworaczek, partenaire France Num et consultant SEO pour des TPE et PME depuis plus d’une décennie, accompagne ses clients dans cette transition vers un contenu à haute valeur ajoutée plutôt que vers la course au volume.

À retenir

Le scaling de contenu sans substance échoue depuis 15 ans, du content spinning au contenu IA en masse. Google a sanctionné chaque vague avec des mises à jour majeures (Panda en 2011, actions manuelles en 2025) et continuera de le faire.

Le volume de pages n’est pas un avantage concurrentiel. C’est un handicap quand il dilue les signaux de qualité de votre domaine et noie vos pages réellement utiles dans du bruit numérique.

Le coût réel du contenu IA de masse inclut la vérification factuelle, le contrôle d’originalité et la supervision éditoriale. Sans ces étapes, vous publiez un risque réputationnel sous votre marque.

Pour une TPE ou une PME, 10 à 15 contenus experts par trimestre génèrent plus de trafic qualifié et de conversions que 500 pages génériques. La qualité est le seul levier qui résiste aux évolutions algorithmiques.

Questions fréquentes

Pourquoi la production de contenu en masse est-elle risquée pour le SEO ?

Google évalue la qualité au niveau du site entier, pas page par page. Publier des centaines d’articles de faible valeur dégrade le signal de qualité global de votre domaine. Depuis juin 2025, Google émet des actions manuelles ciblant spécifiquement l’abus de contenu à grande échelle, entraînant la disparition complète des pages concernées des résultats de recherche.

Peut-on utiliser l’IA pour créer du contenu SEO efficace ?

L’IA est un excellent outil d’assistance à la rédaction quand elle est combinée avec une expertise humaine. Le problème n’est pas l’IA elle-même, mais son utilisation sans supervision pour générer du contenu en masse. Un article assisté par IA, relu et enrichi par un expert métier, peut tout à fait se positionner durablement. Un article généré et publié sans intervention humaine représente un risque SEO et réputationnel.

Combien de contenus une TPE ou PME devrait-elle publier par mois ?

Il n’existe pas de chiffre universel, mais l’expérience terrain montre que 3 à 5 articles de fond par mois, adossés à une vraie expertise métier, produisent de meilleurs résultats que 50 articles génériques. La régularité et la qualité priment sur le volume. Chaque contenu doit répondre à une intention de recherche précise et apporter une valeur que le lecteur ne trouve pas ailleurs.

Comment savoir si ma stratégie de contenu est à risque ?

Vérifiez le ratio entre vos pages indexées et celles qui génèrent réellement du trafic. Si moins de 10 % de vos pages attirent 90 % de votre trafic organique, c’est un signal d’alerte. Les pages restantes diluent probablement la qualité perçue de votre site. Un audit SEO permet d’identifier précisément les contenus à consolider, améliorer ou supprimer.

Le SEO programmatique est-il toujours une stratégie viable ?

Le SEO programmatique fonctionne uniquement quand les données sous-jacentes apportent une valeur réelle à l’utilisateur et que chaque page répond à un besoin spécifique. Les pages-portes générées en masse (“meilleur X à Y” sans contenu original) sont explicitement ciblées par les politiques anti-spam de Google. Si votre approche programmatique repose sur des données propriétaires et un vrai service rendu, elle reste viable. Sinon, elle est un risque.

À vous de construire du contenu qui résiste

Les outils changent tous les cinq ans. Le mur de la qualité, lui, ne bouge pas. Les entreprises qui l’ont compris investissent dans des contenus qui reflètent leur expertise réelle plutôt que dans la multiplication de pages génériques. C’est ce qui sépare une présence en ligne durable d’un château de cartes algorithmique.

Si vous dirigez une TPE ou une PME et que vous vous interrogez sur la solidité de votre stratégie de contenu, un audit de vos pages existantes est le meilleur point de départ. Identifier ce qui performe, ce qui dilue et ce qui manque vous donnera une feuille de route concrète pour les mois à venir. N’hésitez pas à nous contacter pour en discuter.